Hi, chắc bạn đang khổ sở lắm mới tìm được bài viết này trên Google hoặc bạn đang chui vô từ các nhóm mà tui rải link.

Đi thẳng vô vấn đề thì bài này sẽ hướng dẫn bạn cách để sử dụng Flux AI trên ComfyUI và Workflow để chơi với nó.

Tìm hiểu cơ bản về Flux AI

Flux AI là gì?

FLUX.1 là bộ mô hình tạo sinh hình ảnh (text-to-image) vừa mạnh vừa xịn do Black Forest Labs, nhằm đẩy mạnh giới hạn của sự sáng tạo, hiệu quả và đa dạng. Nó dựa trên kiến trúc transformer và được mở rộng lên đến 12 tỷ tham số.

FLUX.1 rất là ổn áp trong việc tạo ảnh mà không cần nhiều kiến thức, yêu cầu cài đặt như MidJourney hay Stable Diffusion.

Có thể hiểu đơn giản hơn là: khả năng tạo ảnh tốt như MidJourney, prompt đơn giản như Dall E, có thể tùy biến cao (sắp bằng nhưng từ từ) như Stable Diffusion nhưng nó miễn phí!

Miễn là bạn có máy tính (mạnh) thì tải về sử dụng thoải mái trên ComfyUI.

Đây là ảnh làm bằng Flux trên ComfyUI luôn :3 tại tui ko tìm thấy logo của họ (hoặc tui lười) 🙂

Black Forest là ai?

Theo họ tự giới thiệu thì họ là một đội ngũ các nhà nghiên cứu và kỹ sư AI xuất sắc với bề dày kinh nghiệm trong việc phát triển các mô hình Generative AI cơ bản trong môi trường học thuật, công nghiệp và nguồn mở.

Nếu bạn đã quen sử dụng Stable Diffusion thì họ cũng là những người tạo nên Stable Diffusion á, nó gồm: VQGAN và Latent Diffusion, các mô hình Stable Diffusion cho hình ảnh và video (Stable Diffusion XL, Stable Video Diffusion, Rectified Flow Transformers), và Adversarial Diffusion Distillation cho tổng hợp hình ảnh siêu nhanh, thời gian thực.

Nói chung họ là một đội ngũ phát triển AI xịn đến từ Châu Âu (tự dựng trong đầu nó chạy quảng cáo gì vậy ta 🙂)

Trang web chính thức của họ là blackforestlabs.ai và tài liệu API có thể tìm thấy tại docs.bfl.ml.

Các Biến Thể Của FLUX.1

Về cơ bản thì nó có 3 biến thể chính gồm 1 cái thương mại chỉ truy cập được bằng API (có thể sử dụng tạo ảnh thương mại) và 2 bản có thể tùy biến tương đối cao gồm:

- FLUX.1 [schnell]: Phiên bản nhanh, phù hợp cho phát triển cục bộ và sử dụng cá nhân. Được phát hành dưới giấy phép Apache 2.0. Có sẵn trên Hugging Face.

- FLUX.1 [dev]: Mô hình chất lượng cao dành cho các ứng dụng phi thương mại. Chất lượng gần tương đương bản Pro nhưng hiệu quả hơn. Có sẵn trên Hugging Face và được cấp phép theo “FLUX.1-dev Non-Commercial License”.

- Các phiên bản [pro] (FLUX.1 [pro], FLUX1.1 [pro], FLUX1.1 [pro] Ultra/raw, FLUX.1 Fill [pro], FLUX.1 Canny [pro], FLUX.1 Depth [pro], FLUX1.1 Redux [pro], FLUX1.1 Redux [pro] Ultra): Đây là các biến thể cao cấp nhất, cung cấp hiệu suất vượt trội, dành cho ứng dụng thương mại và chủ yếu truy cập qua API của Black Forest Labs.

Trong hướng dẫn, chúng ta sẽ chơi với 2 bản là dev và schnell vì có thể tải free để sử dụng thoải mái.

Bộ Công Cụ FLUX Official Tools Suite (Ra mắt tháng 11/2024)

Một cập nhật quan trọng vào tháng 11 năm 2024 là việc Black Forest Labs phát hành bộ công cụ FLUX Official Tools Suite nếu nói quen thuộc hơn thì nó là Controlnet, mở rộng đáng kể chức năng của FLUX.1.

Bộ công cụ này bao gồm:

- FLUX.1 Fill: Công cụ mạnh mẽ cho việc sửa chữa và mở rộng hình ảnh (local redraw, outpainting). Có bản pro và dev.

- FLUX.1 Depth & Canny: Các mô hình ControlNet chuyên nghiệp, cho phép kiểm soát tạo ảnh dựa trên thông tin chiều sâu và cạnh viền. Có bản đầy đủ và LoRA.

- FLUX.1 Redux: Công cụ chuyển đổi phong cách hình ảnh, giữ lại cấu trúc gốc. Bản Ultra hỗ trợ độ phân giải lên đến 4K.

Chức Năng Chính

Nó sử dụng để tạo ảnh và họ cũng đang bắt đầu để tạo thêm phiên bản từ text thành video rồi. Thay vì nói chán phèo kể lại từ mấy bài viết của họ thì trải nghiệm của mình mấy chức năng của nó vầy:

- Tạo ảnh chất lượng cao: Với các prompt tương đối đơn giản, không cần quá nhiều từ khóa phức tạp như Stable Diffusion truyền thống.

- Bám sát prompt tốt: Khả năng diễn giải và thể hiện yêu cầu của người dùng trong ảnh được đánh giá cao.

- Độ phân giải linh hoạt: Hỗ trợ tạo ảnh ở nhiều kích thước, từ 256px đến 2048px (và thậm chí 4K với Redux Ultra Pro), ít bị lỗi thừa chi tiết hay dị dạng ở các kích thước phổ biến.

- Cải thiện về chi tiết (tay, chân): So với nhiều mô hình đời đầu, FLUX.1 cho thấy sự cải thiện trong việc render các chi tiết phức tạp.

- Mở rộng khả năng với FLUX Tools: Inpainting, outpainting, controlnet (Depth, Canny), image variation, style transfer.

- Tiềm năng tạo video: Black Forest Labs cũng đang nghiên cứu phát triển mô hình từ text sang video dựa trên nền tảng FLUX cái này thì trên Reddit người ta bàn thôi 🙂 cũng hay nên tui bỏ vô.

So sánh nhẹ thì nó ăn đứt Stable Diffusion 3, 3.5 về mọi mặt trừ dung lượng và yêu cầu thiết bị sử dụng, nhưng đáng mà!

Mấy cái này là tính theo mình là người không biết gì chui vào và thử nha. Chứ còn hiện tại với tui Stable Diffusion phiên bản XL vẫn là chân ái vì tạo được ảnh NSFW theo í của tui 🙂(thật đê tiện).

Yêu cầu cơ bản để sử dụng

Rồi! Tới phần quan trọng và khó nếu bạn muốn tải về để sử dụng:

- VRam Tối thiểu: 12GB VRAM (NVIDIA). Với mức này, thời gian tạo ảnh 1024×1024 có thể từ vài phút đến khá lâu.

- Khuyến nghị: 24GB VRAM (NVIDIA) để có trải nghiệm tốt hơn và chạy các mô hình lớn hơn. (Nguồn: ComfyUI Wiki, 09/05/2025)

- Card đồ họa: Ưu tiên card NVIDIA. Hỗ trợ cho card AMD có thể phức tạp hơn và đòi hỏi các bước cài đặt bổ sung. ComfyUI cũng đã có những tiến bộ trong việc hỗ trợ Apple Silicon với tăng tốc phần cứng.

- Dung lượng ổ cứng: Tối thiểu 50GB-100GB trống, tùy thuộc vào số lượng model bạn tải. Các model FLUX.1 (ví dụ:

flux1-dev.safetensors) có thể nặng hàng chục GB, cộng thêm các model CLIP, VAE, và môi trường ComfyUI. - RAM hệ thống: Tối thiểu 16GB, khuyến nghị 32GB trở lên.

- CUDA: CUDA 11.8 trở lên (khuyến nghị 12.0 trở lên cho hiệu suất tốt nhất với các card mới).

- Python: Bài viết gốc đề cập Python 3.10. Kiểm tra yêu cầu cụ thể của phiên bản ComfyUI và các node bạn sử dụng. GitHub của Black Forest Labs cũng hướng dẫn cài đặt với Python 3.10.

- Mạng: dĩ nhiên là bạn nên cắm cáp nếu có thể để tải nhanh hơn.

Nên chọn mô hình nào?

- Có điều kiện: Nếu bạn có sẵn thiết bị mạnh bạn nên tải bản dev về để sử dụng vì nó có chất lượng cao hơn rất nhiều so với schnell, tui đang xài nó trên VPS.

- Thiếu điều kiện xíu: Còn nếu bạn muốn trải nghiệm nhiều với FLUX và ComfyUI để tạo ra các tác phẩm bằng AI tốt hơn và máy íu íu như của tui có 6GB vram thì bạn nên chọn schnell. Trải nghiệm cá nhân của tui thấy nó hơi không bằng so với dev nên tui bỏ qua luôn và chọn chơi dev.

- Trải nghiệm nhanh/Thương mại: Sử dụng API của Black Forest Labs để truy cập các phiên bản

[pro]nếu bạn có nhu cầu thương mại hoặc muốn thử nghiệm nhanh mà không cần cài đặt phức tạp. - Đào tạo LORA dùng thương mại: Sử dụng Shakker AI, họ có mua giấy phép sử dụng Flux Dev License cho người dùng và bạn có thể dùng tạo ảnh thương mại miễn phí, cái này rất là ok đối với dân MMO in áo, tạo ảnh,…

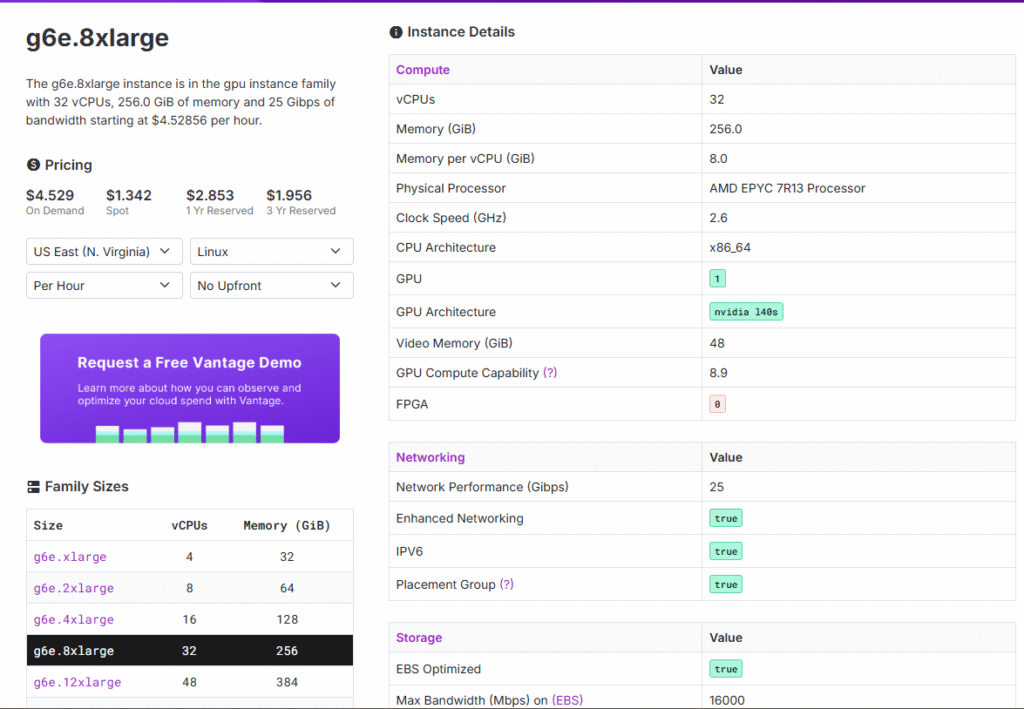

Hiện tại thì mình đang sử dụng phiên bản VPS của AWS như bên dưới để chạy, NVIDIA L40S Tensor Core GPUs 48GB giúp mình tạo ảnh 1024×1024 có 10s/ tấm thôi 🙂 nhưng đổi lại thì giá nó tận gần 5$/ giờ.

Cụ thể hơn bạn có thể hú mình qua:

- Facebook: fb.com/maitruclam4real

- Mail: [email protected]

- Zalo/Viber: 0833141929

Bạn chia sẻ cái bạn có, tui chia sẻ lại VPS, kiến thức sử dụng như thế nào và các loại tài nguyên khác,… Miễn sao 2 bên đều vui là được ^^.

Tải và cài đặt ComfyUI

Từ từ cập nhật sau hoặc bạn có thể tham khảo mấy video này cho nhanh trước khi tui làm:

Trên Window: https://youtu.be/O5hi7H65yUc video của bạn này hướng dẫn luôn việc để các model Flux vào đâu luôn.

Trên Ubuntu: https://www.youtube.com/watch?v=QnNH-Ja42pw cái này thì có phần vietsub dễ hiểu.

Nếu bạn chuyên xíu thì vào trang của nhà phát triển và học cách cài: https://github.com/comfyanonymous/ComfyUI

Trên Windows

Yêu cầu: máy bạn phải có ít nhất 6GB vram để chạy cho mượt, kiểu card 3060 ấy (tại máy tui vậy 🙂)

Bắt buộc phải là card Nvidia, tại AMD không có được hỗ trợ trên Windows.

Bước 1: tải cục này ComfyUI_windows_portable về máy rồi giải nén nó ra.

Bước 2: click đúp để chạy run_nvidia_gpu.bat

Nếu may mắn và máy của bạn cài đủ đồ trước (Python, cập nhật driver Nvidia,…) thì nó sẽ chạy luôn còn không sẽ giống thế này:

Bước 3: cập nhật Driver trên máy tính nếu nó yêu cầu, cài thêm các thứ khác nếu nó yêu cầu.

Bước 4: sau khi cài xong thì cầu trời là nó chạy ổn 🙂 và chạy run_nvidia_gpu.bat thêm một lần nữa.

Nếu nó hiện thế này là bạn đã thành công và nó sẽ tự động mở trình duyệt và giao diện cơ bản của nó như thế này:

Bước 5: bấm vào Queue Prompt để tạo ảnh đầu tiên bằng AI của mình. Dĩ nhiên là nó sẽ báo lỗi thế này:

Vì bạn đã tải mô hình nào đâu 🙂

Để biết cần tải gì thì đọc tiếp nha.

Trên VPS Ubuntu

Cơ bản là nó giống hệt trên Ubuntu thôi nhưng không có giao diện gì hết 🙂 và tui sẽ mặc đinh người đọc hướng dẫn để cài trên VPS là cao thủ sẵn nên chỉ có dòng lệnh thôi nhé.

Nhưng cơ bản thì bạn chỉ cần làm theo hướng dẫn của tui là ổn.

1. Cập nhật hệ thống và cài đặt Python

- Cập nhật và nâng cấp hệ thống: sudo apt update && sudo apt upgrade -y

- Cài đặt các gói cần thiết: sudo apt install python3-venv python3-pip git -y

- Đảm bảo hệ thống sử dụng Python phiên bản phù hợp (nên dùng 3.10 hoặc 3.11). Nếu cần, có thể cài thêm từ kho deadsnakes để lấy bản Python mới nhất.

2. Tải về ComfyUI

- Tải mã nguồn ComfyUI từ GitHub: git clone https://github.com/comfyanonymous/ComfyUI.git cd ComfyUI

3. Cài đặt các thư viện phụ thuộc

- Tạo và kích hoạt môi trường ảo Python (khuyến nghị): python3 -m venv venv source venv/bin/activate

- Cài đặt PyTorch phù hợp với phiên bản CUDA của bạn (thay cuXXX bằng phiên bản CUDA, ví dụ cu118 hoặc cu121): pip install torch torchvision torchaudio –index-url https://download.pytorch.org/whl/cuXXX

- Cài đặt các phụ thuộc còn lại: pip install -r requirements.txt

4. Khởi động ComfyUI

- Chạy ComfyUI với tùy chọn cho phép truy cập từ máy khác hoặc chỉ định cổng: python main.py –listen Có thể thêm

--port XXXXđể chỉ định cổng truy cập nếu cần.

5. Cài đặt ComfyUI Manager

- Để quản lý các node dễ dàng hơn, cài đặt ComfyUI Manager bằng cách: cd ComfyUI/custom_nodes/ git clone https://github.com/ltdrdata/ComfyUI-Manager.git Sau đó khởi động lại ComfyUI để Manager hoạt động.

Sau khi hoàn thành cài đặt ComfyUI, bạn cần tải về các model FLUX.1 cùng các file phụ trợ. Đặt các file này vào đúng thư mục models trong thư mục ComfyUI để sẵn sàng sử dụng.

Cách sử dụng Flux AI trên ComfyUI

Ở phần này thì hướng dẫn chung cả Win lẫn U đều tương tự như nhau, do bạn chỉ cần đủ dung lượng là tải model về và sử dụng thôi.

Cách mới: Đơn giản hơn để sử dụng Flux AI Checkpoint

Tải checkpoint

Nếu bạn muốn tham khảo cách cũ để có nhiều kinh nghiệm hơn trong việc (bầm dập) bạn có thể tham khảo ở dưới. Trong phần này, sau mấy ngày bầm dập tui đã tìm được cách ổn áp hơn để sử dụng Flux AI trên ComfyUI.

Ban đầu là tui có ý định làm nó có thể chạy trên A1111 để dễ sử dụng và quen tay hơn nhưng kết quả là thất bại toàn tập. Nhưng đó là trước khi tui thử ném vô giao diện mặc định của ComfyUI để chạy thử và BÙM! NÓ CHẠY ĐƯỢC!

Tất cả những việc bạn cần làm là tải checkpoint này: Flux 1 Checkpoint và đặt vào mục ComfyUI/models/checkpoints là được.

Bạn chỉ cần sử dụng workflow mặc định của ComfyUI và triển thôi :3

Gợi ý setting trên ComfyUI:

- Số bước: 6 – 30 (20 hoạt động rất ổn)

- Lấy mẫu: eluer – simple

- CGF: 1 – 2.5 (khoản trước và sau hầu hết chúng bị tiếng ồn hoặc rất mờ)

- Kích thước: lớn hơn 256 và nhỏ hơn 2048 (ngoài khoản này đôi khi chúng khá dị dạng và tốn nhiều thời gian).

Về mặt thời gian thì trên VPS với cấu hình:

Nvidia G10 24 GB vRam

64GB ram

800GB bộ nhớ

Thời gian tạo trung bình:

1024×1024 x20steps: 31s

832×1280 x15steps: 21s

Ví dụ tui tạo 1 loạt ảnh kích cỡ 832×1280 với số lượng 15 step thì thời gian là 3p30s là 210s vậy là khoản 21s mỗi tấm ảnh.

Thời gian load checkpoint cũng giảm xuống rất nhiều, từ khoản 2p cho lần đầu thì cái này cần trung bình dưới 1p để load và bắt đầu chạy.

Một vài note nhỏ:

Negative prompt: giống như Stable Diffusion có lúc hoạt động, có lúc không, trong thử nghiệm của tui, các từ khoá như: hình mờ, text, logo, màu sắc,… hoạt động 50/50. Một số thứ cụ thể hơn như logo Disney thì nó có thể nhận diện và xoá bỏ được (tui nghĩ thế vì khi thử thì mất logo và thay vào bằng thứ khác hoặc ko có gì).

A1111: Tui thử vẫn còn ít hoặc tôi vẫn chưa cấu hình chính xác để nó có thể chạy được, tui rất mong các bạn thử và chia sẻ lại (chân thành cảm ơn).

Một vài kết quả khác:

Tự tạo checkpoint từ Flux Dev đã tải về

Phương pháp là:

- Nâng cấp Comfy UI lên phiên bản mới nhất, tại đó có 1 nút mới có tên là ModelMergeFlux1.

- Tạo nút có tên ModelMergeFlux1, bạn chọn VAE, UNET và Flux như bình thường giống trong ảnh ở dưới hoặc tải cái workflow này nếu bạn lười 🙂

- Nhấn vào Queue Prompt và đợi nó hợp thành một model .safetensors: thường nó sẽ nằm ở: ComfyUI/output/checkpoint và có tên là 0001.safetensors nếu bạn không đặt tên.

- Tải workflow bình thường và bắt đầu tận hưởng :3

A1111: Tui thử vẫn còn ít hoặc tui vẫn chưa cấu hình chính xác để nó có thể chạy được, tui rất mong các bạn thử và chia sẻ lại (chân thành cảm ơn).

Cách cũ: Tải các tài nguyên cần thiết

List các tài nguyên cần có

Các tài nguyên cần thiết chính bao gồm 3 (tổng cộng ít nhất 4 file) món thôi:

Nếu bạn biết bỏ ở đâu rồi thì tải về thôi, nếu chưa thì làm theo hướng dẫn sau, trên Windows cũng tương tự vậy thôi, còn hình minh hoạ là từ trong phần mềm quản lý VPS Ubuntu WinSCP mình đang dùng.

Bước 1: Đầu tiên, bạn vào thư mục chứa ComfyUI của mình, và chọn models.

Bước 2: bạn lần lượt tải các mô hình xuống vào các thư mục gồm:

Bước 3: tải mấy thứ cần thiết vào trong các thư mục ở bên trên:

Model

Model chọn 1 trong 2 hoặc cả 2 tuỳ bạn 🙂

- FLUX.1-dev: https://huggingface.co/black-forest-labs/FLUX.1-dev

- FLUX.1-schnell: https://huggingface.co/black-forest-labs/FLUX.1-schnell

Nếu tải bản Dev này thì bạn sẽ cần phải đăng nhập huggingface để tải về vì phải đồng ý vài cái yêu cầu của họ trước khi cho tải.

Sau khi đăng nhập thì tải về thôi:

Nếu là lần đầu bạn sử dụng nó thì sau khi đồng ý xong, bạn chuyển qua tab Files xong kéo xuống tí tìm file nặng nhất tên flux1-dev.safetensors rồi bấm nút tải xuống.

Tải về bỏ nó vào mục: ComfyUI/models/unet/

VAE

VAE: chỉ có 1 cái thôi https://huggingface.co/black-forest-labs/FLUX.1-schnell/blob/main/ae.safetensors

Tải về bỏ vào đây: ComfyUI/models/vae/

CLIP

Bạn sẽ cần tải 2/3 file về hoặc cả 3 cụ thể là:

Link: https://huggingface.co/comfyanonymous/flux_text_encoders/tree/main

Cần clip_l.safetensors

Cần t5xxl_fp8_e4m3fn.safetensors

Nếu máy bạn có trên 32GB ram thì có thể tải: t5xxl_fp16.safetensors thay cho fp8.

Bỏ nó vào đây: ComfyUI/models/clip/

Nếu hoàn tất rồi và mọi thứ ổn thỏa thì chúng ta tới phần sử dụng nào!

Cách sử dụng cơ bản

Tải workflow

Bạn có thể tải workflow đơn giản ở đây: https://drive.google.com/file/d/1v8xd97Qz0gB46xH7wFLsSgePPNMTkF1c/view?usp=sharing hoặc trên Civitai.

Sau khi tải workflow về, giải nén ra thành file json, bạn kéo thẳng vào giao diện của ComfyUI hoặc bấm vào load và chọn vào file json đó để load thành giao diện giống bên dưới.

Làm quen giao diện

Trong phần này thì nó chỉ tóm gọn trong workflow tương tác với Flux thôi nhé:

- Bạn sẽ gõ prompt của mình ở đây bằng tiếng anh nha, để nó cho ra kết quả tốt nhất.

- Model ở đây

- phần CLIP bạn đã tải

- Chỉnh chiều rộng – cao – và số lượng ảnh muốn tạo

- Giảm số step sẽ tạo ảnh nhanh hơn:

- Nếu là Dev hãy 12 – 20

- Nếu là schnell 4 là được! Siêu nhanh luôn, tầm 10s là có anh rồi.

- Nó là VAE

- Cuối cùng khi xong ảnh của bạn sẽ xuất hiện ở đây.

Trên Window, bạn cũng có thể xem ảnh ở phần Outputs.

Lưu ý:

- Ảnh càng to thì thời gian càng lâu

- Số bước càng nhiều thì thời gian càng lâu

Ngoài ra thì bạn có thể thử bấm vào dấu mũi tên trong tất cả các node (mấy khối vuông chữ nhật đó) để xem chuyện gì xảy ra, có gì chỉ cần load lại workflow cũ là được.

Cách viết prompt

Viết prompt đơn giản là bạn nghĩ gì trong đầu thì viết ra thôi, nó sẽ tạo gần giống nếu nó có dữ liệu về những thứ đó.

Bạn cũng có thể viết những thứ siêu dài và phức tạp cũng được luôn!

Một số ví dụ khá hay có thể thử:

- A beautiful Vietnamese girl in Ao Dai white is taking a cruise in Ha Long Bay, Vietnam.

- A girl is dancing with neon lights with many people around enjoying the party.

- Superman with iron man costume

- …

Một số ví dụ về nét chữ:

A pretty Asian girl holding a sign that says “cap cáp ố TvT”

A naughty boy holding a paint can with the words “hello meo meo @ gmiel” on the wall

Như bạn có thể thấy là kết quả về kiểm soát chữ rất là ok luôn á! Chứ không bị nhoè hoặc quá nát như mấy cái mô hình khác.

Ngoài ra bạn cũng có thể thử viết mấy thứ vô nghĩa hoặc viết tiếng Việt cũng được, nhưng có vẻ nó sẽ cho ra các kết quả ngẫu nhiên mà cũng đẹp, chứ không phải như Stable Diffusion tạo ra mấy hình nhiễu dị hợm 🙁

Và bạn có thể thử prompt về gấu trúc, nó kì lạ ở điểm là dữ liệu hình như họ thu thập liên quan tới Trung Quốc nhiều lắm 🙂kiểu nào nó cũng sẽ ra gái búi tóc 2 chùm tròn, chữ Tàu, trang phục Tàu hoặc mấy cái lồng đèn 🙂

Ngoài ra thì nếu bạn prompt là người châu á hoặc Hàn Quốc thì nó sẽ ra gương mặt đôi khi rất Jennie trong BlackPink 🙂

Tóm lại

Nếu bạn không cài đặt được hoặc lỗi hoặc gì đó thì hú tui, tui có thể hướng dẫn free hoặc cà phê cà pháo gì đó hehehe ngại quá chưa gì vòi xèng rồi.

Video thì sẽ sớm lên, có gì thì bạn cứ bình luận dưới đây hoặc liên lạc với tui qua Facebook, Zalo, Mail hoặc ở đâu mà tui thấy là được.

hi mai,

i face error message when using flux after i install it.

ERROR: Could not detect model type of: D:\ComfyUI_windows_portable\ComfyUI\models\checkpoints\flux1Dev_v10.safetensors

need your help. how to fix this

Well, for this error there are quite a few things you will need to check on your device and settings:

Check 1: where did you download that flux1Dev_v10.safetensors, does the guide say it is checkpoint or unet, double check and move it to the correct folder. (I am leaning towards the hypothesis that what you downloaded is Unet instead of checkpoint).

If you run with the default process of comfy ui, you will need to download this checkpoint just download 1 of 2 links (the model is quite big so try to see which one is faster in your area and use it):

1. https://civitai.com/models/628682/flux-1-checkpoint-easy-to-use

2. https://www.shakker.ai/modelinfo/bc47d61f377540deb00b813799972088/Flux-1-full-Checkpoint-Easy-to-use-L-m-Panda?from=personal_page

Check 2: are you using the right python version (preferably python 3.10)

Check 3: if the above 2 things do not solve the problem then you can try recording a video or taking a screenshot and sending it to drive or imgur somewhere and I will take a look.

I’m in the process of updating this blog post, there are now quite a few simpler ways to use FLUX.

hi Lâm

tui muốn uống cf vs bạn :3

kkk cũng đc a ơi e ở SG :))))